Inteligencia artificial (AI) está cambiando rápidamente la forma en que vivimos y trabajamos. Desde automóviles autónomos hasta diagnóstico médico, los modelos de IA se están utilizando para automatizar tareas y tomar decisiones que alguna vez se pensó que eran el dominio exclusivo de los humanos. Sin embargo, a medida que los modelos de IA se vuelven más complejos, comprender cómo funcionan se está volviendo cada vez más difícil. Esta falta de transparencia puede conducir a muchos problemas, incluidos el sesgo, la discriminación e incluso las preocupaciones de seguridad.

Aquí es donde entra la explicabilidad de IA. Explicable AI (XAI) es un conjunto de técnicas que permiten comprender cómo los modelos de IA toman decisiones. Esta información se puede utilizar para mejorar la precisión y la equidad de los modelos de IA, así como para generar confianza en los sistemas de IA.

Esta guía profundizará en lo que es explicable, por qué importa y cómo se puede lograr a través de diversas metodologías y tecnologías.

¿Quiere un software de IA que impulse la automatización y las decisiones más inteligentes?

Comprender la explicabilidad de la IA

La explicación de IA se refiere al proceso de hacer que el funcionamiento interno de los modelos de IA sea comprensible para los humanos. El objetivo es garantizar que los resultados producidos por estos modelos no solo sean precisos sino también interpretables y justificables. Con los servicios de desarrollo de IA creciendo en popularidad, ha habido una creciente necesidad de IA explicable para generar confianza, reducir los sesgos y mejorar la transparencia en la toma de decisiones de IA.

¿Por qué es importante la explicabilidad de la IA?

La incorporación de la explicación de IA puede traer varios beneficios tanto para los desarrolladores como para los usuarios finales:

- Confianza y adopción: la IA explicable ayuda a las partes interesadas a confiar en las decisiones de la IA, alentando su uso más amplio.

- Depuración y mejora: Hacer transparentes modelos de IA permite a los científicos de datos comprender los errores, lo cual es crucial para mejorar la precisión del modelo.

- Cumplimiento: Ciertas industrias requieren explicaciones claras para las decisiones, como en las finanzas y Cuidado de la salud, donde la explicación de IA es vital para cumplir con los requisitos reglamentarios.

- Consideraciones éticas: la IA explicable ayuda a mitigar los sesgos y promueve la equidad en la toma de decisiones automatizada.

¿Cómo funciona la explicación de IA?

Hay una serie de técnicas diferentes que pueden usarse para lograr la explicabilidad de la IA. Algunas de las técnicas más comunes incluyen:

- Explicaciones del modelo integrable local (LIME): esta técnica explica las predicciones de cualquier modelo de aprendizaje automático al aproximarlo localmente con un modelo interpretable.

- Explicaciones aditivas de Shapley (SHAP): esta técnica se basa en la teoría del juego y explica las predicciones de cualquier modelo de aprendizaje automático al calcular la contribución de cada característica a la predicción.

- Árboles de decisión: los árboles de decisión son un tipo de modelo de aprendizaje automático que se puede utilizar para explicar las predicciones de otros modelos de aprendizaje automático.

- Sistemas basados en reglas: los sistemas basados en reglas son un tipo de modelo AI que puede usarse para explicar las predicciones de otros modelos de IA.

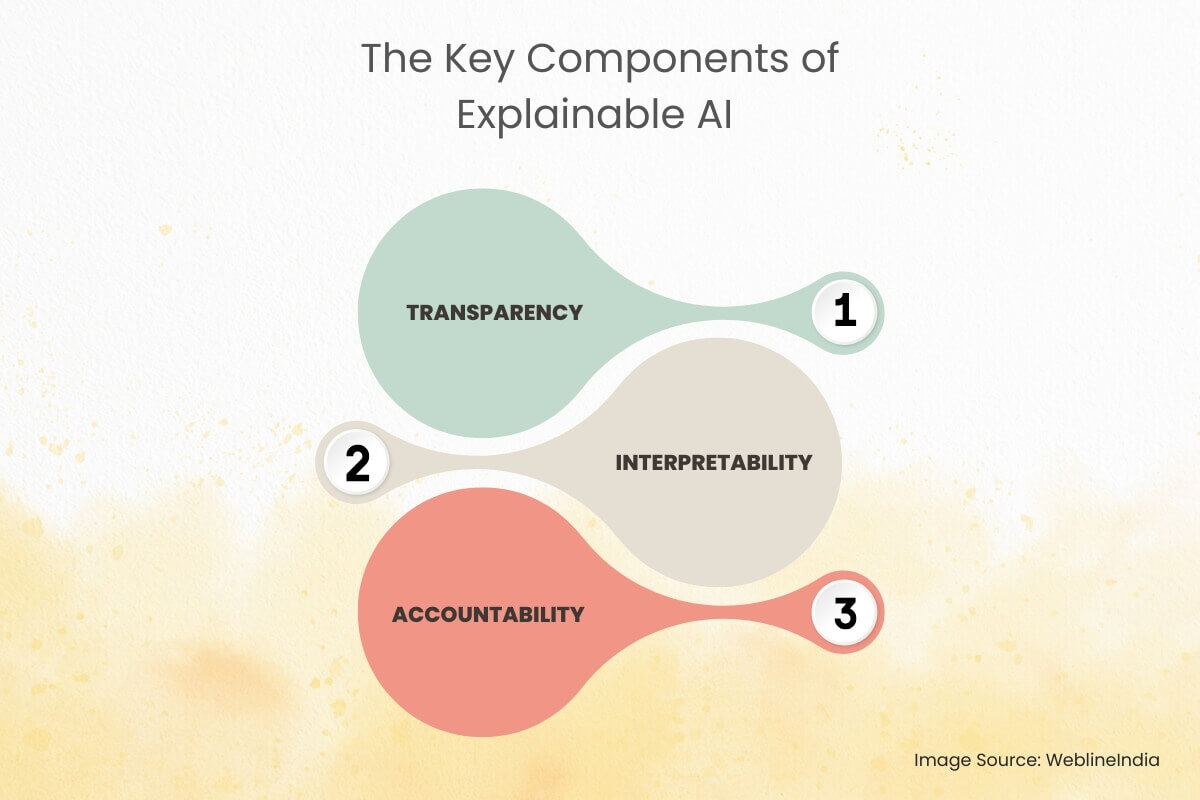

Los componentes clave de la IA explicable

Los componentes centrales de la IA explicable implican transparencia, interpretabilidad y responsabilidad. Comprender cómo los modelos de IA llegan a una conclusión o recomendación particular es esencial para desarrollar sistemas de IA responsables.

A continuación se muestran algunos de los elementos que contribuyen a la explicación de IA:

Transparencia

La transparencia en los servicios de desarrollo de IA significa que los procesos detrás de la capacitación modelo, el uso de datos y la toma de decisiones son claros. Esta transparencia ayuda a los desarrolladores y usuarios a comprender la lógica detrás de los modelos de IA y garantiza la responsabilidad en sus resultados.

Interpretabilidad

La interpretabilidad se refiere a la capacidad de los humanos para comprender las decisiones tomadas por los modelos de IA. Un modelo se considera interpretable si los usuarios pueden entender fácilmente su comportamiento sin necesidad de una comprensión profunda de las matemáticas o algoritmos complejos. Muchos servicios de desarrollo de IA se centran en diseñar modelos con características de interpretabilidad incorporadas para facilitar este proceso.

Responsabilidad

Cuando los modelos de IA producen resultados, la responsabilidad garantiza que las partes interesadas puedan rastrear y verificar estas decisiones. Esto es particularmente crucial en dominios de alto riesgo como la atención médica, la ley o las finanzas, donde las decisiones tomadas por los modelos de IA pueden tener consecuencias significativas.

¿Busca el desarrollo de IA que garantice la precisión y el cumplimiento?

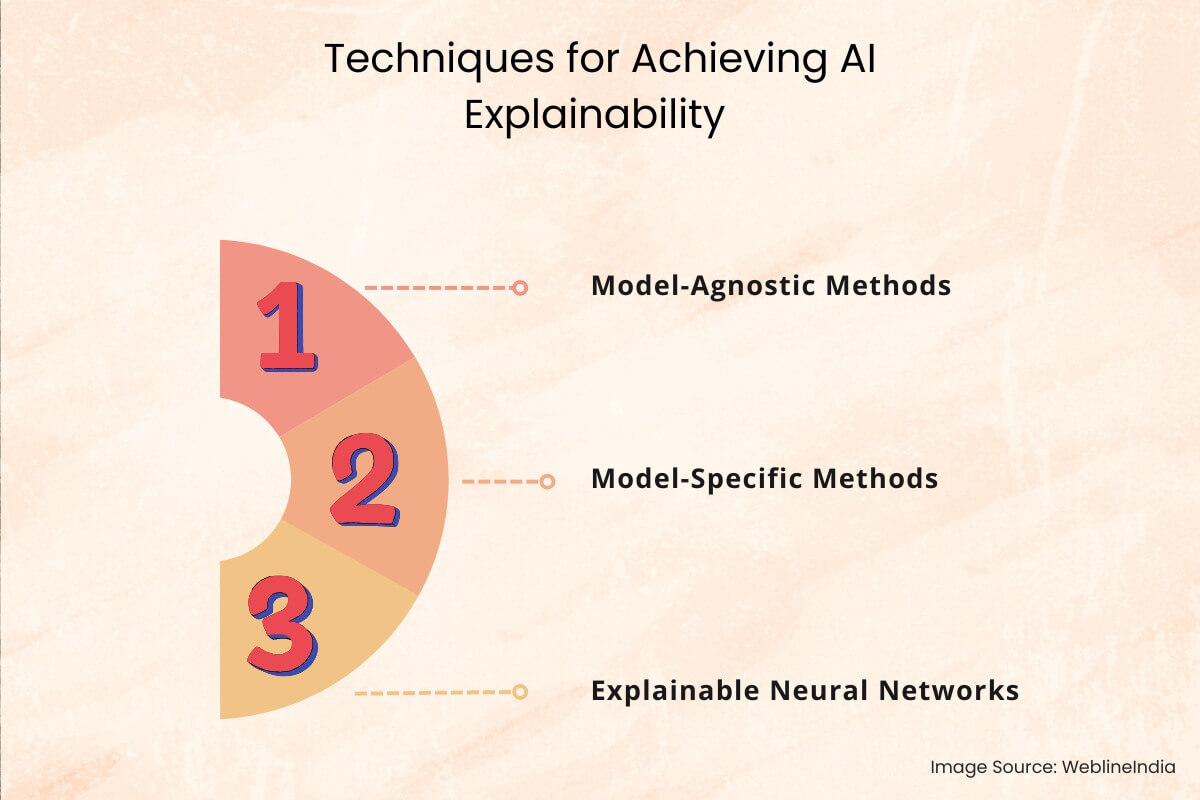

Técnicas para lograr la explicabilidad de la IA

Lograr la explicabilidad de la IA implica emplear varias técnicas para comprender cómo los modelos de IA toman decisiones. Estos métodos incluyen cal, que se aproxima a los modelos localmente con explicaciones interpretables, y SHAP, que utiliza la teoría de juegos para determinar las contribuciones de características.

Además, los árboles de decisión y los sistemas basados en reglas ofrecen una transparencia inherente al visualizar las vías de decisión y las reglas explícitas, respectivamente, ayudando a comprender el comportamiento del modelo de IA y generar confianza en sus predicciones.

Estos incluyen:

1. Métodos del modelo agnóstico

Estas técnicas se aplican a cualquier modelo, independientemente de la arquitectura, y proporcionan información sobre cómo las entradas influyen en las salidas. Algunos métodos comunes incluyen:

- Lime (explicaciones del modelo interpretable local y agnóstico): genera un modelo más simple e interpretable que se aproxima al modelo complejo de IA localmente alrededor de una predicción específica.

- Shap (explicaciones aditivas de Shapley): ayuda a explicar las predicciones individuales calculando la contribución de cada característica a la salida.

2. Métodos específicos del modelo

Ciertos modelos de IA son más interpretables que otros. Por ejemplo, los árboles de decisión y los modelos de regresión lineal son inherentemente más fáciles de entender que los modelos de aprendizaje profundo. Las técnicas específicas de ciertos modelos de IA incluyen:

- Análisis de importancia de la característica: en los modelos basados en árboles de decisión como los bosques aleatorios, esta técnica evalúa la importancia de cada característica para hacer predicciones.

- Mapas de activación: para redes neuronales convolucionales (CNN) en el procesamiento de imágenes, los mapas de activación visualizan qué áreas de una imagen contribuyen más a la decisión tomada por el modelo AI.

3. Redes neuronales explicables

Aunque los modelos de aprendizaje profundo como las redes neuronales a menudo se consideran “cajas negras”, hay formas de mejorar su explicabilidad. Algunos métodos incluyen:

- Mecanismos de atención: estos métodos permiten a los modelos centrarse en características de entrada específicas que son más relevantes para la predicción.

- Mapas de prominencia: en la visión por computadora, los mapas de saliencia visualizan áreas de una imagen que tienen el mayor impacto en las predicciones.

Beneficios de la IA explicable en los servicios de desarrollo de IA

La implementación de AI explicable es esencial para las organizaciones que ofrecen servicios de desarrollo de IA. Asegura que los clientes entiendan cómo funcionan los modelos de IA y toman decisiones, lo que finalmente genera confianza en la tecnología.

A continuación se presentan algunas ventajas clave:

- Maestría en la toma de decisiones: con modelos transparentes y comprensibles, Inteligencia artificial en los negocios Permite a las empresas tomar decisiones mejor informadas basadas en salidas de IA.

- Reducción del riesgo: tener explicaciones claras para las predicciones de los modelos de IA, reduce la probabilidad de resultados inesperados o dañinos, particularmente en aplicaciones sensibles.

- Cumplimiento regulatorio: a menudo se requiere explicación para cumplir con los estándares legales y regulatorios en industrias como finanzas, atención médica y seguro.

Desafíos en la implementación de IA explicable

La implementación de AI explicable (XAI) no está exenta de obstáculos. Equilibrar la necesidad de explicación de IA con la precisión y el rendimiento del modelo puede ser complicado. Los modelos de IA altamente complejos pueden ser difíciles de interpretar incluso con técnicas XAI.

Comunicar explicaciones a las partes interesadas con diferentes niveles de comprensión técnica plantea otro desafío. Finalmente, la falta de métodos y métricas de XAI estandarizados hace que sea difícil evaluar y comparar diferentes enfoques:

1. Complejidad de los modelos de IA

Muchos modelos de IA avanzados, como las redes de aprendizaje profundo, operan a través de arquitecturas complejas que dificultan interpretar cómo llegan a decisiones específicas. Esto es especialmente cierto cuando se trabaja con grandes conjuntos de datos que requieren técnicas de procesamiento sofisticadas.

2. Complicación entre precisión y explicación

A menudo existe una compensación entre la precisión de un modelo y su explicación. Los modelos más complejos tienden a ofrecer una mayor precisión, pero a expensas de ser menos interpretables. Pasar el equilibrio correcto entre estos dos factores es un desafío continuo en los servicios de desarrollo de IA.

3. Falta de estandarización

Actualmente no existe un marco universalmente aceptado para la explicabilidad de IA. Hay diferentes modelos, herramientas y enfoques disponibles, pero su efectividad puede variar mucho según el contexto y la aplicación específicos. Esta falta de estandarización hace que sea más difícil implementar la IA explicable en todas las industrias.

El futuro de la IA explicable

Explicable AI es un campo de investigación relativamente nuevo. Sin embargo, es un campo de rápido crecimiento. A medida que los modelos de IA se vuelven más complejos, la necesidad de explicación de IA solo aumentará.

Hay una serie de iniciativas en marcha para promover el desarrollo y la adopción de la IA explicable. Por ejemplo, la Agencia de Proyectos de Investigación Avanzada de Defensa (DARPA) está financiando la investigación sobre la IA explicable. La Unión Europea también está trabajando en un conjunto de pautas para la IA explicable.

La IA explicable es una herramienta importante para garantizar que los modelos de IA sean justos, precisos y confiables. A medida que la IA continúa desempeñando un papel cada vez más importante en nuestras vidas, la IA explicable se volverá aún más importante.

¿Cómo puedes comenzar con la IA explicable?

Si desea comenzar con AI explicable, hay varios recursos disponibles para ayudarlo. Hay varios libros y artículos sobre IA explicable. También hay una serie de herramientas de código abierto que se pueden usar para explicar las predicciones de los modelos de IA.

Servicios de desarrollo de IA También puede ayudarlo con la IA explicable. Varias compañías ofrecen servicios de desarrollo de IA que pueden ayudarlo a desarrollar e implementar modelos de IA explicables. Explicable AI es un tema importante para cualquier persona interesada en la IA. Comprender la IA explicable puede ayudarlo a tomar decisiones informadas sobre el uso de la IA.

Hashtags sociales

#ExplicabilidadDeLaIA #InteligenciaArtificial #IA #IAExplicable #TransparenciaDeLaIA #DesarrolloDeLaIA #AutomatizaciónDeLaIA #InnovaciónDeLaIA #FuturoDeLaIA

¿Quiere un software de IA que impulse la automatización y las decisiones más inteligentes?

Testimonials: Hear It Straight From Our Customers

Our development processes delivers dynamic solutions to tackle business challenges, optimize costs, and drive digital transformation. Expert-backed solutions enhance client retention and online presence, with proven success stories highlighting real-world problem-solving through innovative applications. Our esteemed clients just experienced it.