בעוד אנו מתקדמים לעבר העולם הטכנולוגי המודרני, עיבד אוטומציה בעזרת פיתוח בינה מלאכותית וכ ןפיתוח למידת מכונה הפך לעמוד השדרה של תעשיות שונות מכיוון שהוא מבטיח יעילות, מהירות ואפקטיביות עלות. מצד שני, הטיית אוטומציה הפכה לדאגה משמעותית. זה אמור להוות דאגה מכיוון שככל שעסקים וארגונים ממשיכים לאמץ אוטומציה של תהליכים, רבים אינם מודעים לתוצאות הפוטנציאליות שיש למערכות אוטומטיות אלה על הגינות ושוויון.

למרות שהאוטומציה מביאה יעילות ונוחות, היא יכולה גם להציג הטיות עדינות ועם זאת חזקות שמנציחות אפליה ואי שוויון. הבנת הדינמיקה של הטיית אוטומציה היא קריטית בטיפול בסוגיות אלה ויצירת מערכות המקדמות הגינות לכולם.

רוצה לגלות כיצד ליצור מערכות אוטומטיות לא משוחדות עם AI אתי?

מהי הטיית אוטומציה?

הטיית אוטומציה מתייחסת לנטייה של בני אדם להתייחס יתר על המידה על מערכות אוטומטיות, בהנחה שההחלטות שלהם נכונות מבלי להטיל ספק בהן. בעולם בו מכונות נתפסות לרוב כבלתי ניתנות לניתוק, אמון זה יכול להוביל לתוצאות מזיקות.

בפועל, הטיית אוטומציה פירושה שבני אדם עשויים להתעלם מפסקי הדין שלהם ולהסתמך על החלטות שהתקבלו על ידי מערכת אוטומטית, גם כאשר מערכות אלה פגומות או מוטות. לדוגמה, בתהליכי גיוס, חברות רבות מסתמכות יותר ויותר על מערכות אוטומטיות כדי לסקר קורות חיים או הערכת מועמדים. מערכות אלה, אמנם יעילות, יכולות להנציח הטיות אם הן מאומנות על נתונים מוטים.

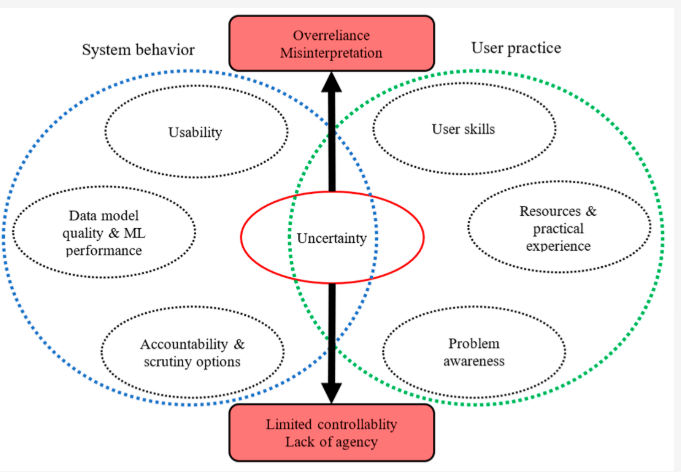

מָקוֹר: MDPI על דיווח על ML מתקדם וכריית נתונים

כתוצאה מכך, המועמדים מקבוצות המייצגות תת -מיוצגות עלולות להיות מוקרנות באופן לא הוגן, אף על פי שהכישורים שלהם שווים לאחרים או עדיפים על אחרים. זוהי דוגמא ברורה לאופן בו הטיית אוטומציה יכולה לתרום ישירות לאי -שוויון.

כיצד אוטומציה של תהליכים יכולה להגביר אפליה

בְּעוֹד אוטומציה של תהליכיםיכול לייעל פעולות ולשפר את היעילות, זה יכול גם להגביר הטיה אלגוריתמית אם לא מנוהל בקפידה. הטיה אלגוריתמית מתייחסת לפייבוריטיזם שיטתי או לאפליה הגלומה במערכות אוטומטיות. אם הנתונים המשמשים לאימוני אלגוריתמים אלה מכילים הטיות-כגון מין, גזע או הטיות סוציו-אקונומיות-המערכת האוטומטית ככל הנראה תירש ואף תגביר הטיות אלה. ההשלכות של הטיית אוטומציה מרחיקות לכת ויכולות להיות בעלות השלכות חמורות על יחידים והחברה כולה. זה יכול להוביל ל:

- הזדמנויות מופחתות: אלגוריתמים מוטים יכולים להגביל את הגישה לשירותים תעסוקתיים, חינוך ושירותים פיננסיים עבור קבוצות מסוימות.

- חיזוק סטריאוטיפים: מערכות אוטומטיות שמנציחות סטריאוטיפים יכולות עוד יותר לשוליים קהילות מוחלשות כבר.

- שחיקת אמון: ככל שאנשים מודעים לפוטנציאל ההטיה במערכות אוטומטיות, זה יכול להוביל לאובדן אמון במוסדות ובטכנולוגיה.

שקול כיצד AI ואי-שוויון מצטלבים בתרחישים בעולם האמיתי. במערכת המשפט הפלילית, אלגוריתמים חזויים משמשים כדי להעריך את הסבירות להפעלה חוזרת. עם זאת, אם הנתונים אלגוריתמים אלה מסתמכים עליהם משקפים הטיות היסטוריות, כמו שיעורי מעצר גבוהים באופן לא פרופורציונלי ביישובים מסוימים, הטיה של AI במערכות אלה עלולות לגרום לתוצאות לא הוגנות, כמו משפטים ארוכים יותר למיעוטים. זוהי דוגמה מוחלטת לאופן שבו הטיית אוטומציה יכולה להנציח את אי השוויון החברתי.

באופן דומה, בתחום הבריאות, לאוטומציה של תהליכים יכולות להיות השלכות לא מכוונות. אם אלגוריתם מתאמן על נתונים המייצגים יותר מדי דמוגרפיה מסוימת תוך ייצוג של אחרים, המערכת עשויה להגיש תחזיות או המלצות לא מדויקות. זה יכול להוביל להפסקות בטיפול רפואי, כאשר קבוצות שוליות מקבלות טיפול נחות או לא מאובחנות במועד.

כמה מקרים ידועים של הטיות של אלגוריתם AI

נכון שההסתמכות אך ורק על AI יכולה לפעמים להוביל לתוצאות לא הוגנות. הִנֵה דוח שפורסם על ידי מכון Greenlining זה מציג כמה דוגמאות לאופן בו הוטלו אלגוריתמים במצבים שונים:תוכניות ממשלתיות:

- מערכת האבטלה של מישיגן: מישיגן השתמשה באלגוריתם כדי לאתר הונאה בתביעות אבטלה. לרוע המזל, המערכת האשימה בטעות אלפי אנשים, מה שהוביל לקנסות, פשיטות רגל ואפילו עיקולים. התברר שהאלגוריתם לעתים קרובות טעויות ולא היה מי שיבדוק שוב את החלטותיו.

- ארקנסו מדיקאיד: אלגוריתם שימש כדי לקבוע מי העפיל להטבות מדיקאיד בארקנסו. זה הביא לכך שאנשים רבים איבדו גישה לטיפול רפואי חיוני. הבעיה? לאלגוריתם היו שגיאות, והיה קשה מאוד לאנשים לערער על החלטותיו.

תַעֲסוּקָה:

- כלי ההעסקה של אמזון: אמזון ניסתה ליצור אלגוריתם שיעזור להם להעסיק את העובדים הטובים ביותר. עם זאת, האלגוריתם בסופו של דבר העדיף גברים על פני נשים. נראה שהאלגוריתם שנלמד מנתוני שכירת בעבר, שאולי הכיל הטיות.

שירותי בריאות:

- טיפול לא שוויוני: אפילו כאשר האלגוריתמים נועדו להיות הוגנים, הם יכולים לשמש בדרכים שיוצרות הטיה. לדוגמה, בית חולים השתמש באלגוריתם כדי להחליט אילו חולים זקוקים לטיפול נוסף. לרוע המזל, הדרך בה השתמשו פירושה שחולים שחורים היו צריכים להיות הרבה יותר חולים מאשר חולים לבנים כדי לקבל את אותה רמת תשומת לב.

הַשׂכָּלָה:

- הטיית דירוג בבריטניה: במהלך המגיפה, בתי הספר בבריטניה השתמשו באלגוריתם כדי לתת כיתות סטודנטים כאשר בוטלו הבחינות. עם זאת, האלגוריתם בסופו של דבר העביר ציונים נמוכים יותר לסטודנטים ממשפחות בעלות הכנסה נמוכה, והראה כיצד אלגוריתמים יכולים לפעמים לחזק לפעמים את אי השוויון הקיים.

דִיוּר:

- הקרנה לא הוגנת: בעלי קרקע רבים משתמשים באלגוריתמים כדי לסקר דיירים פוטנציאליים. אלגוריתם אחד כזה מנע באופן לא הוגן של אם לשכור דירה מכיוון שבנה עבר עבירה קלה ברשומה שנדחה אחר כך.

- השקעה בדטרויט: אלגוריתם שימש בדטרויט כדי להחליט אילו שכונות צריכות לקבל השקעות ושיפורים. זה הביא לכך ששכונות שחורות ועניות בעיקר נדחו משאבים, והראו כיצד אלגוריתמים יכולים להחמיר בעיות חברתיות קיימות.

דוגמאות אלה מראות שלמרות שאלגוריתמים יכולים להיות כלים חזקים, הם צריכים להיות מעוצבים בקפידה ולהשתמש בהם באחריות כדי למנוע חוסר הוגנות ואפליה. עלינו להבטיח כי אלגוריתמים ישמשו לקידום הגינות ושוויון, ולא להנציח הטיות קיימות.

התמודדות עם הטיית אוטומציה והטיה אלגוריתמית

התייחסות להטיית אוטומציה ופוטנציאל שלה להנציח הטיה אלגוריתמית דורשת גישה רב-פנים. ראשית, חיוני להבטיח שהנתונים המשמשים לאימון אלגוריתמים הם מגוונים ומייצגים את כל הקבוצות הדמוגרפיות. ללא נתונים מגוונים, אלגוריתמים מסתכנים בחיזוק הטיות קיימות במקום להתייחס אליהם.

שנית, שקיפות ואחריות חייבים להיות מובנים במערכות AI ומערכות אוטומציה. מפתחים צריכים להיות ברורים כיצד מערכות אלה מתפקדות ולהיות פתוחות לבדיקה. ביקורת קבועה של אלגוריתמים יכולות לעזור בזיהוי תחומים שבהם ניתן להטיה, וניתן ליישם אמצעים מתקנים לפני שההיות הללו משפיעות מזיקות.

לבסוף, ניתן למזער את AI ואי -שוויון על ידי קידום הגינות וכלול לאורך שלבי התכנון והפריסה. על ידי שילוב נוהלי AI אתיים, חברות יכולות להבטיח שפתרונות האוטומציה של התהליכים שלהם לא רק יעילים אלא גם צודקים ושוויוניים.

זהה וטיפול בהטיה אוטומטית בתהליכים שלך עם הנחיות המומחים שלנו

תפקיד WeblineIndia בטיפול בהטיה אוטומטית

לעסקים המעוניינים לרתום את כוחו של אוטומציה של תהליכים תוך הבטחת הגינות, שקיפות ואחריות אתית, Weblineindia בולט כשותף מהימן עם שלה דגם Rellshore של מיקור חוץ. כמומחים בשילוב טכנולוגיה מתקדמת עם שיקולים אתיים, WeblineIndia מצטיין בטיפול באתגרים של הטיית אוטומציה. הם מחויבים ליצור פתרונות מונעים AI שממזערים את ההטיה האלגוריתמית ולקדם AI ומודעות אי-שוויון.

הגישה של WeblineIndia היא ייחודית בכך שהיא מאזנת את היתרונות של אוטומציה עם דגש על אתיקה של אלגוריתם, ומבטיחה כי הטכנולוגיה תשמש באחריות ואינה מנצחת אפליה. בין אם זה פיתוח תוכנה בהתאמה אישית, יישום פתרונות אוטומציה של תהליכים, או לייעץ באסטרטגיות להפחתת הטיה של AI, הצוות של WeblineIndia מתעדף את האיכות, ההוגנות והאחריות החברתית.

מוכנים לבנות פתרונות תוכנה לא משוחדים המופעלים על ידי AI?

בחר WeblineIndia ואנחנו יכולים להיות סמוכים ובטוחים שאתה משתף פעולה עם ספק שירות שלא רק מבין את המורכבות הטכנית של AI אלא גם מתעדף שיקולים אתיים. יחד, אנו יכולים לבנות עתיד בו הטכנולוגיה עובדת עבור כולם, לא נגדם.

לסיכום, בעוד שאוטומציה של תהליכים מציעה פוטנציאל עצום, חשוב להיות מודע לסיכונים שמציבים הטיית אוטומציה ש- WeblineIndia דואגת לה. אנו יכולים להבטיח שמערכות AI ומערכות אוטומציה יהיו כלים לטוב, לקידום הגינות, הכלול ושוויון בכל תחומי החיים על ידי הבנת האופן בו פועלת הטיה אלגוריתמית ולנקוט בצעדים כדי לטפל בה. צרו קשר ואנחנו עוזרים לך לנווט באתגר זה, ליצור פתרונות המקיימים את הסטנדרטים הגבוהים ביותר של אחריות אתית.

Hashtags חברתיים

#AutomationBias #EthicalAI #BiasInTech #StopAlgorithmic Discrimination #AI #Automation #AIAutomation #SoftwareSolutions

רוצה לבנות פתרונות מכילים והוגנים AI לעסק שלך?

Testimonials: Hear It Straight From Our Customers

Our development processes delivers dynamic solutions to tackle business challenges, optimize costs, and drive digital transformation. Expert-backed solutions enhance client retention and online presence, with proven success stories highlighting real-world problem-solving through innovative applications. Our esteemed clients just experienced it.