Mens vi går videre mot den moderne teknologiske verden, må du behandle automatisering ved hjelp av Kunstig intelligensutvikling og Utvikling av maskinlæring har blitt ryggraden i forskjellige bransjer da det lover effektivitet, hastighet og kostnadseffektivitet. På den annen side har automatiseringsskjevhet blitt en betydelig bekymring. Dette bør være en bekymring fordi når bedrifter og organisasjoner fortsetter å ta i bruk prosessautomatisering, er mange uvitende om de potensielle konsekvensene disse automatiserte systemene kan ha på rettferdighet og likhet.

Selv om automatisering gir effektivitet og bekvemmelighet, kan den også introdusere subtile, men kraftige skjevheter som foreviger diskriminering og ulikhet. Å forstå dynamikken i automatiseringsskjevhet er avgjørende for å løse disse problemene og lage systemer som fremmer rettferdighet for alle.

Vil du oppdage hvordan du lager objektive automatiserte systemer med etisk AI?

Hva er automatiseringsskjevhet?

Automasjonsskjevhet refererer til tendensen til mennesker til å styre på automatiserte systemer, forutsatt at beslutningene deres er riktige uten å stille spørsmål ved dem. I en verden der maskiner ofte blir sett på som ufeilbarlige, kan denne tilliten føre til skadelige konsekvenser.

I praksis betyr automatiseringsskjevhet at mennesker kan ignorere sine egne dommer og stole på beslutninger tatt av et automatisert system, selv når disse systemene er feil eller partisk. For eksempel, i ansettelsesprosesser, er mange selskaper i økende grad avhengig av automatiserte systemer for å screene CV eller evaluere kandidater. Disse systemene, selv om de er effektive, kan forevige skjevheter hvis de er opplært på partiske data.

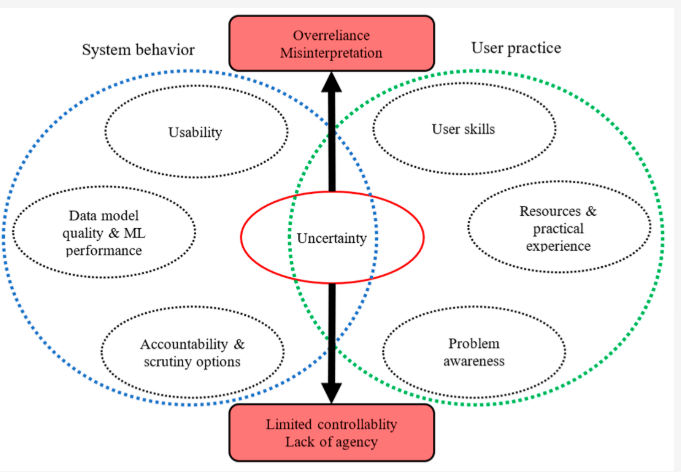

Kilde: MDPI om rapportering av avansert ML og data mining

Som et resultat kan søkere fra underrepresenterte grupper bli urettferdig vist ut, selv om kvalifikasjonene deres er lik eller overlegen andre. Dette er et tydelig eksempel på hvordan automatiseringsskjevhet direkte kan bidra til ulikhet.

Hvordan prosessautomatisering kan forsterke diskriminering

Mens prosessautomatisering Kan effektivisere operasjoner og forbedre effektiviteten, den kan også forsterke algoritmisk skjevhet hvis ikke styres nøye. Algoritmisk skjevhet refererer til den systematiske favorismen eller diskriminering som ligger i automatiserte systemer. Hvis dataene som brukes til å trene disse algoritmene inneholder skjevheter-for eksempel kjønn, rase eller sosioøkonomiske skjevheter-vil det automatiserte systemet sannsynligvis arve og til og med forsterke disse skjevhetene.

Implikasjonene av automatiseringsskjevhet er vidtrekkende og kan ha alvorlige konsekvenser for enkeltpersoner og samfunn som helhet. Det kan føre til:

- Reduserte muligheter: Partiske algoritmer kan begrense tilgangen til sysselsetting, utdanning og finansielle tjenester for visse grupper.

- Forsterkning av stereotyper: Automatiserte systemer som foreviger stereotyper kan ytterligere marginalisere allerede vanskeligstilte samfunn.

- Erosjon av tillit: Når folk blir klar over potensialet for skjevhet i automatiserte systemer, kan det føre til tap av tillit til institusjoner og teknologi.

Tenk på hvordan AI og ulikhet krysser hverandre i den virkelige scenariene. I det strafferettssystemet brukes prediktive algoritmer for å vurdere sannsynligheten for gjenfortredelse. Imidlertid, hvis dataene disse algoritmene er avhengige av gjenspeiler historiske skjevheter, for eksempel uforholdsmessig høyere arrestasjonsrate i visse samfunn, kan AI -skjevheten i disse systemene føre til urettferdige resultater, for eksempel lengre setninger for minoriteter. Dette er et sterkt eksempel på hvordan automatiseringsskjevhet kan forevige samfunnsmessige ulikheter.

Tilsvarende kan prosessautomatisering ha utilsiktede konsekvenser i helsevesenet ha utilsiktede konsekvenser. Hvis en algoritme er opplært på data som over representerer visse demografier mens de representerer andre, kan systemet komme med unøyaktige spådommer eller anbefalinger. Dette kan føre til avvik i medisinsk behandling, med marginaliserte grupper som får underordnet behandling eller ikke blir diagnostisert på en riktig måte.

Noen kjente tilfeller av AI -algoritme -skjevheter

Er det sant at det å stole utelukkende på AI noen ganger kan føre til urettferdige utfall. Her er En rapport publisert av Greenlining Institute Det viser noen få eksempler på hvordan algoritmer har vært partisk i forskjellige situasjoner:

Regjeringsprogrammer:

- Michigans arbeidsledighetssystem: Michigan brukte en algoritme for å oppdage svindel i arbeidsledighetskrav. Dessverre anklaget systemet feilaktig tusenvis av mennesker, noe som førte til bøter, konkurser og til og med tvangsinngrep. Det viste seg at algoritmen ofte gjorde feil, og det var ingen som dobbeltsjekket beslutningene.

- Arkansas Medicaid: En algoritme ble brukt til å avgjøre hvem som kvalifiserte seg til Medicaid -fordeler i Arkansas. Dette resulterte i at mange mennesker mistet tilgangen til essensiell medisinsk behandling. Problemet? Algoritmen hadde feil, og det var veldig vanskelig for folk å anke beslutningene.

Arbeid:

- Amazons ansettelsesverktøy: Amazon prøvde å lage en algoritme for å hjelpe dem med å ansette de beste ansatte. Imidlertid endte algoritmen med å favorisere menn fremfor kvinner. Det ser ut til at algoritmen har lært fra tidligere ansettelsesdata, som kan ha inneholdt skjevheter.

Helsetjenester:

- Ulik behandling: Selv når algoritmer er designet for å være rettferdige, kan de brukes på måter som skaper skjevhet. For eksempel brukte et sykehus en algoritme for å bestemme hvilke pasienter som trengte ekstra pleie. Dessverre, slik de brukte, betydde det at svarte pasienter måtte være mye sykere enn hvite pasienter for å få samme oppmerksomhetsnivå.

Utdannelse:

- Gradering av skjevhet i Storbritannia: Under pandemien brukte skoler i Storbritannia en algoritme for å gi elevene karakterer da eksamen ble kansellert. Imidlertid endte algoritmen med å gi lavere karakterer til elever fra familier med lavere inntekt, og viste hvordan algoritmer noen ganger kan forsterke eksisterende ulikheter.

Bolig:

- Urettferdig screening: Mange utleiere bruker algoritmer for å screene potensielle leietakere. En slik algoritme forhindret urettferdig en mor fra å leie en leilighet fordi sønnen hennes hadde en mindre krenkelse på rekorden hans som senere ble avskjediget.

- Disinvestering i Detroit: En algoritme ble brukt i Detroit for å bestemme hvilke nabolag som skulle motta investeringer og forbedringer. Dette resulterte i at overveiende svarte og fattige nabolag ble nektet ressurser, og viste hvordan algoritmer kan forverre eksisterende sosiale problemer.

Disse eksemplene viser at selv om algoritmer kan være kraftige verktøy, må de være nøye designet og brukes ansvarlig for å unngå urettferdighet og diskriminering. Vi må sørge for at algoritmer brukes til å fremme rettferdighet og likhet, ikke forevige eksisterende skjevheter.

Takle automatiseringsskjevhet og algoritmisk skjevhet

Å adressere automatiseringsskjevhet og potensialet for å forevige algoritmisk skjevhet krever en mangesidig tilnærming. For det første er det viktig å sikre at dataene som brukes til å trene algoritmer er forskjellige og representative for alle demografiske grupper. Uten forskjellige data risikerer algoritmer å forsterke eksisterende skjevheter i stedet for å adressere dem.

For det andre må åpenhet og ansvarlighet bygges inn i AI- og automatiseringssystemer. Utviklere bør være tydelige på hvordan disse systemene fungerer og være åpne for granskning. Regelmessige revisjoner av algoritmer kan bidra til å identifisere områder der skjevhet kan være til stede, og korrigerende tiltak kan iverksettes før disse skjevhetene har skadelige effekter.

Endelig kan AI og ulikhet minimeres ved å fremme rettferdighet og inkludering gjennom design- og distribusjonsfasene. Ved å integrere etisk AI -praksis, kan selskaper sikre at prosessautomatiseringsløsningene deres ikke bare er effektive, men også rettferdige og rettferdige.

Identifiser og adresser automatiseringsskjevhet i prosessene dine med vår ekspertveiledning

WeblineIndia rolle i å adressere automatiseringsskjevhet

For bedrifter som ønsker å utnytte kraften i prosessautomatisering mens du sikrer rettferdighet, åpenhet og etisk ansvar, skiller Weblineindia seg ut som en pålitelig partner med sin RelyShore -modell av outsourcing. Som eksperter på å integrere nyskapende teknologi med etiske betraktninger, utmerker WeblineIndia seg for å takle utfordringene med automatiseringsskjevhet. De er opptatt av å lage AI-drevne løsninger som minimerer algoritmisk skjevhet og fremmer AI og ulikhetsbevissthet.

WeblineIndia tilnærming er unik ved at den balanserer fordelene med automatisering med fokus på algoritmeetikk, og sikrer at teknologien brukes ansvarlig og ikke foreviger diskriminering. Om det utvikler tilpasset programvare, implementering Prosessautomatiseringsløsninger, eller gi råd om strategier for AI -skjevhet, WebLineindias team prioriterer kvalitet, rettferdighet og samfunnsansvar.

Klar til å bygge objektive programvareløsninger drevet av AI?

Velg Weblineindia, så kan vi være sikre på at du samarbeider med en tjenesteleverandør som ikke bare forstår de tekniske vanskeligheter med AI, men også prioriterer etiske hensyn. Sammen kan vi bygge en fremtid der teknologi fungerer for alle, ikke mot dem.

Avslutningsvis, mens prosessautomatisering gir et enormt potensial, er det avgjørende å være klar over risikoen som automatiseringsskjevhet utgjør som Weblineindia tar seg av. Vi kan sikre at AI og automatiseringssystemer er verktøy for god, og fremmer rettferdighet, inkludering og likhet på alle livsområder ved å forstå hvordan algoritmisk skjevhet fungerer og ta skritt for å løse det. Kontakt oss Og vi hjelper deg med å navigere i denne utfordringen og lage løsninger som opprettholder de høyeste standardene for etisk ansvar.

Sosiale hashtags

#AutomationBias #Ethicalai #Biasintech #StopalgorithMicDiscrimination #AI #Automation #Aiautomation #SoftWaresolutions

Vil du bygge inkluderende og rettferdige AI-drevne løsninger for bedriften din?

Testimonials: Hear It Straight From Our Customers

Our development processes delivers dynamic solutions to tackle business challenges, optimize costs, and drive digital transformation. Expert-backed solutions enhance client retention and online presence, with proven success stories highlighting real-world problem-solving through innovative applications. Our esteemed clients just experienced it.