Medan vi går vidare mot den moderna tekniska världen, bearbetar automatisering med hjälp av Utveckling av konstgjord intelligens och Maskininlärningsutveckling har blivit ryggraden i olika branscher eftersom det lovar effektivitet, hastighet och kostnadseffektivitet. Å andra sidan har automatiseringsbias blivit ett betydande problem. Detta bör vara ett problem eftersom när företag och organisationer fortsätter att anta processautomation är många inte medvetna om de potentiella konsekvenserna som dessa automatiserade system kan ha på rättvisa och jämlikhet.

Även om automatisering ger effektivitet och bekvämlighet, kan den också införa subtila men ändå kraftfulla fördomar som upprätthåller diskriminering och ojämlikhet. Att förstå dynamiken i automatiseringsbias är avgörande för att ta itu med dessa frågor och skapa system som främjar rättvisa för alla.

Vill du upptäcka hur man skapar opartiska automatiserade system med etisk AI?

Vad är automatisering bias?

Automationsförskjutning hänvisar till människors tendens att för mycket på automatiserade system, förutsatt att deras beslut är korrekta utan att ifrågasätta dem. I en värld där maskiner ofta ses som ofelbara kan detta förtroende leda till skadliga konsekvenser.

I praktiken innebär automatiseringsförskjutning att människor kan ignorera sina egna bedömningar och förlita sig på beslut som fattas av ett automatiserat system, även om dessa system är felaktiga eller partiska. Till exempel, i anställningsprocesser, förlitar många företag alltmer på automatiserade system för att screena CV eller utvärdera kandidater. Dessa system kan, även om de är effektiva, försvara fördomar om de utbildas på partisk data.

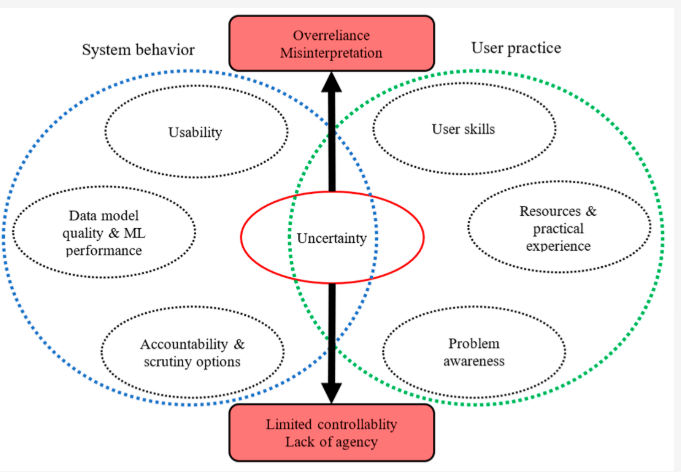

Källa: MDPI om rapportering avancerad ML och data mining

Som ett resultat kan sökande från underrepresenterade grupper orättvist screenas, även om deras kvalifikationer är lika med eller överlägsna andra. Detta är ett tydligt exempel på hur automatiseringsförskjutning direkt kan bidra till ojämlikhet.

Hur processutomation kan förstärka diskriminering

Medan procentera automatisering Kan effektivisera operationer och förbättra effektiviteten, den kan också förstärka algoritmisk förspänning om den inte noggrant hanteras. Algoritmisk partiskhet hänvisar till den systematiska favoritism eller diskriminering som är inneboende i automatiserade system. Om de uppgifter som används för att utbilda dessa algoritmer innehåller fördomar-såsom kön, ras eller socioekonomiska fördomar-kommer det automatiserade systemet troligen att ärva och till och med förstärker dessa fördomar.

Konsekvenserna av automatiseringsförspänning är långtgående och kan få allvarliga konsekvenser för individer och samhälle som helhet. Det kan leda till:

- Minskade möjligheter: Biaserade algoritmer kan begränsa tillgången till sysselsättning, utbildning och finansiella tjänster för vissa grupper.

- Förstärkning av stereotyper: Automatiserade system som upprätthåller stereotyper kan ytterligare marginalisera redan missgynnade samhällen.

- Erosion av förtroende: När människor blir medvetna om potentialen för förspänning i automatiserade system kan det leda till förlust av förtroende för institutioner och teknik.

Tänk på hur AI och ojämlikhet korsar sig i verkliga scenarier. I det straffrättsliga systemet används prediktiva algoritmer för att bedöma sannolikheten för återanvändning. Men om de uppgifter som dessa algoritmer förlitar sig på återspeglar historiska fördomar, såsom oproportionerligt högre arresteringsgrader i vissa samhällen, kan AI -förspänningen i dessa system resultera i orättvisa resultat, såsom längre straff för minoriteter. Detta är ett starkt exempel på hur automatiseringsförskjutning kan försvara samhälleliga ojämlikheter.

På samma sätt kan processautomation inom sjukvården få oavsiktliga konsekvenser. Om en algoritm utbildas på data som överrepresents vissa demografi medan de underrepresenterar andra, kan systemet göra felaktiga förutsägelser eller rekommendationer. Detta kan leda till avvikelser i medicinsk vård, med marginaliserade grupper som fick underlägsen behandling eller inte diagnostiseras i rätt tid.

Vissa kända fall av AI -algoritmfördomar

Ar det sant att att bara förlita sig på AI ibland kan leda till orättvisa resultat. Här är En rapport publicerad av Greenlining Institute Det visar några exempel på hur algoritmer har varit partiska i olika situationer:

Regeringsprogram:

- Michigans arbetslöshetssystem: Michigan använde en algoritm för att upptäcka bedrägerier i arbetslöshetsanspråk. Tyvärr anklagade systemet felaktigt tusentals människor, vilket ledde till böter, konkurser och till och med avskärmningar. Det visade sig att algoritmen ofta gjorde misstag och det fanns ingen att dubbelkontrollera sina beslut.

- Arkansas Medicaid: En algoritm användes för att bestämma vem som kvalificerade sig för Medicaid -förmåner i Arkansas. Detta resulterade i att många förlorade tillgången till väsentlig medicinsk vård. Problemet? Algoritmen hade fel, och det var mycket svårt för människor att överklaga sina beslut.

Sysselsättning:

- Amazons anställningsverktyg: Amazon försökte skapa en algoritm för att hjälpa dem att anställa de bästa anställda. Men algoritmen slutade gynna män framför kvinnor. Det verkar som om algoritmen lärt sig av tidigare anställningsdata, som kan ha innehöll fördomar.

Healthcare:

- Ojämlik behandling: Även när algoritmer är utformade för att vara rättvisa kan de användas på sätt som skapar partiskhet. Till exempel använde ett sjukhus en algoritm för att bestämma vilka patienter som behövde extra vård. Tyvärr, hur de använde det innebar det att svarta patienter måste vara mycket sjukare än vita patienter för att få samma uppmärksamhetsnivå.

Utbildning:

- Graderingsförskjutning i Storbritannien: Under pandemin använde skolor i Storbritannien en algoritm för att ge studenter betyg när tentor avbröts. Algoritmen slutade emellertid med att ge lägre betyg till studenter från familjer med lägre inkomst, vilket visar hur algoritmer ibland kan stärka befintliga ojämlikheter.

Hus:

- Orättvis screening: Många hyresvärdar använder algoritmer för att screena potentiella hyresgäster. En sådan algoritm hindrade orättvist en mamma från att hyra en lägenhet eftersom hennes son hade ett mindre brott mot hans rekord som senare avskedades.

- Desinvestering i Detroit: En algoritm användes i Detroit för att bestämma vilka stadsdelar som ska få investeringar och förbättringar. Detta resulterade i att övervägande svarta och fattiga stadsdelar nekades resurser, vilket visade hur algoritmer kan förvärra befintliga sociala problem.

Dessa exempel visar att även om algoritmer kan vara kraftfulla verktyg, måste de vara noggrant utformade och användas ansvarsfullt för att undvika orättvisa och diskriminering. Vi måste se till att algoritmer används för att främja rättvisa och jämlikhet, inte upprätthålla befintliga fördomar.

Hantera automatiseringsförskjutning och algoritmisk förspänning

Att ta itu med automatiseringsförskjutning och dess potential att försvara algoritmisk förspänning kräver en mångfacetterad strategi. För det första är det viktigt att se till att de data som används för att utbilda algoritmer är olika och representativa för alla demografiska grupper. Utan olika data riskerar algoritmer att förstärka befintliga fördomar snarare än att hantera dem.

För det andra måste transparens och ansvarsskyldighet byggas in i AI och automatiseringssystem. Utvecklare bör vara tydliga om hur dessa system fungerar och vara öppna för granskning. Regelbundna granskningar av algoritmer kan hjälpa till att identifiera områden där förspänning kan vara närvarande, och korrigerande åtgärder kan genomföras innan dessa fördomar har skadliga effekter.

Slutligen kan AI och ojämlikhet minimeras genom att främja rättvisa och inkludering i hela design- och distributionsfaserna. Genom att integrera etiska AI -metoder kan företag se till att deras processautomationslösningar inte bara är effektiva utan också rättvist och rättvisa.

Identifiera och adressera automatiseringsförspänning i dina processer med vår expertvägledning

WeblineIndia roll i att adressera Automatisering Bias

För företag som vill utnyttja kraften i processautomation samtidigt som man säkerställer rättvisa, öppenhet och etiskt ansvar, sticker WebLineIndia som en betrodd partner med dess Relyshore Model outsourcing. När experter på att integrera banbrytande teknik med etiska överväganden utmärker WeblineIndia i att hantera utmaningarna med automatiseringsförskjutning. De är engagerade i att skapa AI-drivna lösningar som minimerar algoritmisk förspänning och främjar AI och ojämlikhet.

WeblineIndia strategi är unik genom att den balanserar fördelarna med automatisering med fokus på algoritmetik, vilket säkerställer att tekniken används ansvarsfullt och inte upprätthåller diskriminering. Oavsett om det utvecklar anpassad programvara, implementering Processautomationslösningar eller rådgivning om AI -förspänningstrategier, WeblineIndias team prioriterar kvalitet, rättvisa och socialt ansvar.

Redo att bygga opartiska mjukvarulösningar som drivs av AI?

Välj weblineindia så kan vi vara säkra på att du samarbetar med en tjänsteleverantör som inte bara förstår de tekniska komplikationerna i AI utan också prioriterar etiska överväganden. Tillsammans kan vi bygga en framtid där teknik fungerar för alla, inte mot dem.

Sammanfattningsvis, medan processautomation erbjuder en enorm potential, är det avgörande att vara medveten om de risker som automatiseras som WeblineIndia tar hand om. Vi kan se till att AI- och automatiseringssystem är verktyg för god, främja rättvisa, inkludering och jämlikhet inom alla livsområden genom att förstå hur algoritmisk partiskhet fungerar och vidta åtgärder för att ta itu med det. Kontakta oss Och vi hjälper dig att navigera i denna utmaning och skapa lösningar som upprätthåller de högsta standarderna för etiskt ansvar.

Sociala hashtags

#AutomationBias #ethicalai #BiasIntech #StopalGorithmicDiscrimination #AI #Automation #Aiautomation #SoftWaresolutions

Vill du bygga inkluderande och rättvisa AI-drivna lösningar för ditt företag?

Testimonials: Hear It Straight From Our Customers

Our development processes delivers dynamic solutions to tackle business challenges, optimize costs, and drive digital transformation. Expert-backed solutions enhance client retention and online presence, with proven success stories highlighting real-world problem-solving through innovative applications. Our esteemed clients just experienced it.